Luukkonen: DSM-5: Merkkisysteeminen diagnostiikka

Re: DSM-5: J o h d a n t o

DTK-5.

-

Psykopatologia - Ylläpitäjä

- Viestit: 57805

- Liittynyt: 12.02.2010 13:19

- Paikkakunta: Helsinki

Re: DSM-5: J o h d a n t o

Diagnostinen ja tilastollinen käsikirja viisi.

-

Psykopatologia - Ylläpitäjä

- Viestit: 57805

- Liittynyt: 12.02.2010 13:19

- Paikkakunta: Helsinki

Re: DSM-5: J o h d a n t o

1.3. Kysymys reliabiliteetista nousee esiin

Testi-psykologiassa kysymys *reliabiliteetista on liki yhtä vanha kuin testaus-psykologia, siis yli sata vuotta (mm. englantilainen statistikko Edward Charles Spearman, 1863 – 1945). Psykiatriaan reliabilteetti tuli vasta DSM:n kehittelyn myötä 1970-luvulla, kun esitettiin skaala- eli asteikkomuotoiset psyykkisten häiriöiden St. Louis- tai Feighner-kriteerit (1972 et al.) koulukunnan yhden johtohahmon mukaan (yhdysvaltalainen psykiatri John Preston Feighner 1937 – 2006, Washington University School of Medicine in St. Louis). Vuonna 1978 – tulevan DSM-III:n ennakkona – Columbia Universityn (NY) psykiatri Robert Leopold Spitzer (1932–) ja nais-psykologi Jean Endicott (1936–) sekä St. Louisin psykiatri Eli Robins (1921 – 1994) esittivät (Spitzer et al. 1978) diagnostiset tutkimus-kriteerit (Research Diagnostic Criteria, RDC), jotka saivat laajennettuina ilmauksensa vallankumouksellisessa DSM-III:sa (1980). ICD-10:een (1992) Diagnostic Criteria for Research (ICD-10: DCR) tuli vasta vuonna 1993 (Green book).

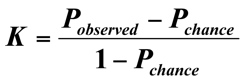

DSM:ssä fokus on ollut testaus – uusintatestaus -reliabiliteetissa (test – retest), siis mittarin stabiliteettissa eli siinä, kuinka samanlainen tulos on uusinnassa toisen arvioitsijan tekemänä. Kyseessä on siis (myös) arvioitsijoiden välinen reliabiliteetti (inter - rater), jonka mittauksen yksinkertaisin muoto on yksimielisyys-prosentti. Tällainen prosentti ei kuitenkaan ota huomioon sattuman tai arvauksen osuutta: esimerkiksi kolikonheiton ”arvioinnissa” (kuunu – klaava) yksimielisyys-prosentiksi tulee ajan mittaan 50. DSM:ssä arvioitsija-reliabiliteetin mittariksi on vakiintunut *Cohen’in kappa-kerron (κ), joka pyrkii eliminoimaan sattuman ja pyrkii tuomaan esiin arvioitsijoiden todellisen yksimielisyyden.

Kaavana:

Symbolein:

DSM:n asteikot koostuvat nominaali- eli laatuero-asteikollisista (dikotomisista) väittämistä (on/ei), ja myös koko skaala on nominaalinen (häiriö todetaan/häiriötä ei todeta). (Tällöin käytettään painottamatonta kappaa. Jos kyseessä olisivat ordinaali- eli järjestys-asteikolliset skaalat, tulisi käyttää painotettua (weighted) kappaa.)

Saadun κ -kertoimen sanoma ei kuitenkaan ole itsestään selvä. Sim & Wright (2005) tuovat esiin kolme tekijää, jotka vaikuttavat kappan oikeaan tai todelliseen arvoon: 1 *prevalenssi-efekti, 2 *bias-efekti ja 3 arvioiden ei-riippumattomuus.

P r e v a l e n s s i-efekti

Taulukko 1.

A. Assessment of the presence of lateral shift, from Kilpikoski et al. (κ = 0,18).

B. The same data adjusted to give equal agreements in cells a & d, and thus a low prevalence index (κ = 0,54).

Sim & Wright 2005: 261. http://ptjournal.apta.org/content/85/3/ ... l.pdf+html

Arvioitavan attribuutin (häiriön merkkien tai häiriön tms.) prevalenssi on vaikutta-massa kappa-kertoimen arvoon. Jos arvioitsijoiden positiivisten tai negatiivisten arvioiden määrä on joko pieni tai suuri (yllä olevassa 1A-kontingenssi-taulukossa ruudut a & d; 28–2), myös sattumanvaraisten arvioiden määrä, prevalenssi-indeksi, on suuri, esimerkissä 0,67, joka antaa sattumanvaraisen yksimielisyyden osuudeksi 0,72, jolloin κ laskee 0,18:aan – Taulukossa 1B prevalenssi-indeksi on nolla (15 – 15), mikä alentaa sattumanvaraisen yksimielisyyden arvoon 0,50, jolloin kappa nousee 0,54:ään. Korkea prevalenssi-indeksi alentaa kappa-kertoimen arvoa.

B i a s-efekti

Taulukko 2.

A. Contingency table showing nearly symmetrical disagreements in cells b and c, and thus a low bias index (κ = 0.12).

B. Contingency table with asymmetrical disagreements in cells b and c and thus a higher bias index (κ = 0.20).

Sim & Wright 2005: 262. (Hypothetical data for diagnoses of spondylolisthesis (present or absent) by two clinicians.)

http://ptjournal.apta.org/content/85/3/ ... l.pdf+html

Bias on arvioitsijoiden tekemien positiivisten (tai negatiivisten) erimielisyyksien määrä, jota ilmentää ero b & c -ruuduissa (2A:ssa symmetrisest 23 – 21; 2B:ssä epäsymmetrisesti 38 – 6). (Paradoksaalisesti) korkea bias-indeksi nostaa kappa-kertoimen arvoa.

Kirjoittajat (pp. 263 – 264; taulukko 6) tuovat esiin myös PABAKin (prevalence-adjusted-bias-adjusted kappa), joka kuitenkin luo ”hypoteettisen” tilanteen ilman prevalenssia ja biasia. PABAKin rinnalla tulisikin esittää alkuperäinen kappa. Referenssiksi voitaisiin laskea myös κmax (pp. 264 – 265).

Sim & Wright (pp. 266 – 269) suosittavat mm. että alkuperäisen kappan rinnalla tulisi tuoda esiin prevalenssi ja bias. He kehottavat varovuuteen, kun verrataan kappaa muuttujia, joilla on eri suuri prevalenssi ja bias, tai jos mittaukset on tehty eri muuttujilla.

Spitzer & Fleiss (1974: 341–347; 344) ovat koonneet yhteen kuuden psykiat-risen tutkimuksen kappa-kertoimia. (Nimimerkki 1 Boring Old Man 2012 a.)

1 Schmidt & Fonda (1956), N 426 (Connecticut).

2 Kreitman (1961), N 90 (England).

3 Beck et al. (1962), N 153 (Philadelphia).

4 Sandifer et al. (1964) N 91 (North Carolina).

5 US – UK Diagnostic Project, Cooper et al. (1972).

6 Spitzer et al. (1975?), N 100 (Washington Heights).

Spitzer et al. (1978: 773 – 782; 779) tutkivat RDC-diagnoosien kappa-kertoimia kolmessa tutkimuksessa. (Nimimerkki 1 Boring Old Man 2012 a.)

A & B ”Joint”: Haastatteluissa läsnä kaksi arvioitsijaa, joista toinen teki haastattelun; riippumattomat arviot.

A RDC:n early draft (New York). B RDC:n first edition (New York, Iowa, St. Louis & Massachusetts).

C Aito test – retest, RDC:n second edition (New York, Iowa, St. Louis & Massachusetts).

29.11.2013 9:13

Testi-psykologiassa kysymys *reliabiliteetista on liki yhtä vanha kuin testaus-psykologia, siis yli sata vuotta (mm. englantilainen statistikko Edward Charles Spearman, 1863 – 1945). Psykiatriaan reliabilteetti tuli vasta DSM:n kehittelyn myötä 1970-luvulla, kun esitettiin skaala- eli asteikkomuotoiset psyykkisten häiriöiden St. Louis- tai Feighner-kriteerit (1972 et al.) koulukunnan yhden johtohahmon mukaan (yhdysvaltalainen psykiatri John Preston Feighner 1937 – 2006, Washington University School of Medicine in St. Louis). Vuonna 1978 – tulevan DSM-III:n ennakkona – Columbia Universityn (NY) psykiatri Robert Leopold Spitzer (1932–) ja nais-psykologi Jean Endicott (1936–) sekä St. Louisin psykiatri Eli Robins (1921 – 1994) esittivät (Spitzer et al. 1978) diagnostiset tutkimus-kriteerit (Research Diagnostic Criteria, RDC), jotka saivat laajennettuina ilmauksensa vallankumouksellisessa DSM-III:sa (1980). ICD-10:een (1992) Diagnostic Criteria for Research (ICD-10: DCR) tuli vasta vuonna 1993 (Green book).

DSM:ssä fokus on ollut testaus – uusintatestaus -reliabiliteetissa (test – retest), siis mittarin stabiliteettissa eli siinä, kuinka samanlainen tulos on uusinnassa toisen arvioitsijan tekemänä. Kyseessä on siis (myös) arvioitsijoiden välinen reliabiliteetti (inter - rater), jonka mittauksen yksinkertaisin muoto on yksimielisyys-prosentti. Tällainen prosentti ei kuitenkaan ota huomioon sattuman tai arvauksen osuutta: esimerkiksi kolikonheiton ”arvioinnissa” (kuunu – klaava) yksimielisyys-prosentiksi tulee ajan mittaan 50. DSM:ssä arvioitsija-reliabiliteetin mittariksi on vakiintunut *Cohen’in kappa-kerron (κ), joka pyrkii eliminoimaan sattuman ja pyrkii tuomaan esiin arvioitsijoiden todellisen yksimielisyyden.

Kaavana:

Symbolein:

DSM:n asteikot koostuvat nominaali- eli laatuero-asteikollisista (dikotomisista) väittämistä (on/ei), ja myös koko skaala on nominaalinen (häiriö todetaan/häiriötä ei todeta). (Tällöin käytettään painottamatonta kappaa. Jos kyseessä olisivat ordinaali- eli järjestys-asteikolliset skaalat, tulisi käyttää painotettua (weighted) kappaa.)

Saadun κ -kertoimen sanoma ei kuitenkaan ole itsestään selvä. Sim & Wright (2005) tuovat esiin kolme tekijää, jotka vaikuttavat kappan oikeaan tai todelliseen arvoon: 1 *prevalenssi-efekti, 2 *bias-efekti ja 3 arvioiden ei-riippumattomuus.

P r e v a l e n s s i-efekti

Taulukko 1.

A. Assessment of the presence of lateral shift, from Kilpikoski et al. (κ = 0,18).

B. The same data adjusted to give equal agreements in cells a & d, and thus a low prevalence index (κ = 0,54).

Sim & Wright 2005: 261. http://ptjournal.apta.org/content/85/3/ ... l.pdf+html

Arvioitavan attribuutin (häiriön merkkien tai häiriön tms.) prevalenssi on vaikutta-massa kappa-kertoimen arvoon. Jos arvioitsijoiden positiivisten tai negatiivisten arvioiden määrä on joko pieni tai suuri (yllä olevassa 1A-kontingenssi-taulukossa ruudut a & d; 28–2), myös sattumanvaraisten arvioiden määrä, prevalenssi-indeksi, on suuri, esimerkissä 0,67, joka antaa sattumanvaraisen yksimielisyyden osuudeksi 0,72, jolloin κ laskee 0,18:aan – Taulukossa 1B prevalenssi-indeksi on nolla (15 – 15), mikä alentaa sattumanvaraisen yksimielisyyden arvoon 0,50, jolloin kappa nousee 0,54:ään. Korkea prevalenssi-indeksi alentaa kappa-kertoimen arvoa.

B i a s-efekti

Taulukko 2.

A. Contingency table showing nearly symmetrical disagreements in cells b and c, and thus a low bias index (κ = 0.12).

B. Contingency table with asymmetrical disagreements in cells b and c and thus a higher bias index (κ = 0.20).

Sim & Wright 2005: 262. (Hypothetical data for diagnoses of spondylolisthesis (present or absent) by two clinicians.)

http://ptjournal.apta.org/content/85/3/ ... l.pdf+html

Bias on arvioitsijoiden tekemien positiivisten (tai negatiivisten) erimielisyyksien määrä, jota ilmentää ero b & c -ruuduissa (2A:ssa symmetrisest 23 – 21; 2B:ssä epäsymmetrisesti 38 – 6). (Paradoksaalisesti) korkea bias-indeksi nostaa kappa-kertoimen arvoa.

Kirjoittajat (pp. 263 – 264; taulukko 6) tuovat esiin myös PABAKin (prevalence-adjusted-bias-adjusted kappa), joka kuitenkin luo ”hypoteettisen” tilanteen ilman prevalenssia ja biasia. PABAKin rinnalla tulisikin esittää alkuperäinen kappa. Referenssiksi voitaisiin laskea myös κmax (pp. 264 – 265).

Sim & Wright (pp. 266 – 269) suosittavat mm. että alkuperäisen kappan rinnalla tulisi tuoda esiin prevalenssi ja bias. He kehottavat varovuuteen, kun verrataan kappaa muuttujia, joilla on eri suuri prevalenssi ja bias, tai jos mittaukset on tehty eri muuttujilla.

Spitzer & Fleiss (1974: 341–347; 344) ovat koonneet yhteen kuuden psykiat-risen tutkimuksen kappa-kertoimia. (Nimimerkki 1 Boring Old Man 2012 a.)

1 Schmidt & Fonda (1956), N 426 (Connecticut).

2 Kreitman (1961), N 90 (England).

3 Beck et al. (1962), N 153 (Philadelphia).

4 Sandifer et al. (1964) N 91 (North Carolina).

5 US – UK Diagnostic Project, Cooper et al. (1972).

6 Spitzer et al. (1975?), N 100 (Washington Heights).

Spitzer et al. (1978: 773 – 782; 779) tutkivat RDC-diagnoosien kappa-kertoimia kolmessa tutkimuksessa. (Nimimerkki 1 Boring Old Man 2012 a.)

A & B ”Joint”: Haastatteluissa läsnä kaksi arvioitsijaa, joista toinen teki haastattelun; riippumattomat arviot.

A RDC:n early draft (New York). B RDC:n first edition (New York, Iowa, St. Louis & Massachusetts).

C Aito test – retest, RDC:n second edition (New York, Iowa, St. Louis & Massachusetts).

29.11.2013 9:13

-

Psykopatologia - Ylläpitäjä

- Viestit: 57805

- Liittynyt: 12.02.2010 13:19

- Paikkakunta: Helsinki

Re: DSM-5: J o h d a n t o

Ko. luvuissa ei ole yhtään yksimielisyys-prosenttia.

Kaikki ovat kappa-kertoimia.

Kaikki ovat kappa-kertoimia.

-

Psykopatologia - Ylläpitäjä

- Viestit: 57805

- Liittynyt: 12.02.2010 13:19

- Paikkakunta: Helsinki

Re: DSM-5: J o h d a n t o

Eikö yksimielisyys-prosenttia käytetäkään arvioitaessa haastatteluja?

- Pinja

Re: DSM-5: J o h d a n t o

Psykopatologia kirjoitti:Psykopatologia kirjoitti:

DSM-5: kappa-kertoimia: keskiarvoja 95 %:n CI -arvoineen tutkimuspaikkakunnittain (vasemmalla aikuiset [18+ -vuotiaat]; oikealla lapset & nuoret [6 – 17 -vuotiaat]) (Boring Old Man 2012). http://1boringoldman.com/index.php/2012 ... f-forests/

Aikuiset (18+ -vuotiaat)

1 CAMH = Centre for Addiction and Mental Health, Toronto, Canada.

N 242; ka 40 (sd 6,3).

2 UT-SA = University of Texas, San Antonio.

N 176; ka 37 (sd 6,1).

3 MAYO = Mayo Clinic, Rochester, Minnesota.

N 209: ka 52 (sd 7,0).

4 DVA = Dallas Veterans Administration Medical Center, Texas.

N 243; ka 52 (sd 4,5).

5 HVA-M = Houston Veterans Administration Medical Center & Menninger Clinic, Tex.

N 272; ka 38 (sd 5,6).

6 UCLA = University of California Los Angeles.

N 220; ka 71 (sd 4,6).

7 PEN = University of Pennsylvania, Philadelphia.

N 203; ka 44 (sd 6,4).

Lapset & nuoret (6 – 17 -vuotiaat)

8 Baystate = Baystate Medical Center, Springfield, Massachusets.

N 168; ka 11 (sd 1,5).

9 Stanford = Stanford University, Palo Alto, California.

N 162; ka 14 (2,0)

10 Colorado = The Children’s Hospital, Aurora, Colorado.

N 220; ka 11 (sd 1,4)

11 Columbia = Columbia University, NY

N 131; ka 11,5 (sd 1,7)

-

Psykopatologia - Ylläpitäjä

- Viestit: 57805

- Liittynyt: 12.02.2010 13:19

- Paikkakunta: Helsinki

Re: DSM-5: J o h d a n t o

From: Pertti Luukkonen <pertti_luukkonen@kolumbus.fi>

To: hckhome@pacbell.net

Sent: Saturday, December 14, 2013 6:45 AM

Subject: DSM-5 Field Trials, prevalence-bias?

Dear Madam Kraemer

I am writing a book about DSM-5 in Finnish.

Does your formullas (Eq. 1) & (Eq. 2) (page 47) take account of prevalence-bias? (Sim & Wright, below).

DSM-5 Field Trials 1. Clarke, Diana E. et al. (2013) (William E. Narrow, Darrel E. Regier, S. Janet Kuramoto, David J. Kupfer, Emily A. Kuhl, Lisa Greiner & Helena C. Kraemer [8]): Article. DSM-5 field trials in the United States and Canada, Part I: study design, sampling strategy, implementation, and analytic approaches. Am J Psychiatry (AJP), 2013 Jan 1; 170 (1): 43–58. (16 p.) Google: "DSM V Field Trials AJP Part 1 pdf" (p. 47)

Sim, Julius & Chris C. Wright (2005): Perspective. The Kappa Statistic in Reliability Studies: Use, Interpretation, and Sample Size Requirements. Physical Therapy 2005 (March), Vol. 85, no 3: 257–286. (12 p.) Google: “Sim Kappa Statistic Reliability 2005 pdf”

pp. 261 - 262.

Pertti Luukkonen, psychologist, Lic.Phil.

viewtopic.php?f=10&t=4557

"Reliability" has long been defined as the ratio of the true to the observed variance of the measures assessed. In the case of a binary outcome, the true measure for subject (i) is p(i), the probability that a randomly chosen observation is positive. Thus the intraclass kappa is defined as k=Variance(p(i))/PP', where P (equal to the expected value of p(i) over subjects) is the prevalence in the population of subjects sampled, and P'=1-P. PP' is the variance of a single binary observation in that population.

(- -)

I hope this helps. Helena Kraemer

To: hckhome@pacbell.net

Sent: Saturday, December 14, 2013 6:45 AM

Subject: DSM-5 Field Trials, prevalence-bias?

Dear Madam Kraemer

I am writing a book about DSM-5 in Finnish.

Does your formullas (Eq. 1) & (Eq. 2) (page 47) take account of prevalence-bias? (Sim & Wright, below).

DSM-5 Field Trials 1. Clarke, Diana E. et al. (2013) (William E. Narrow, Darrel E. Regier, S. Janet Kuramoto, David J. Kupfer, Emily A. Kuhl, Lisa Greiner & Helena C. Kraemer [8]): Article. DSM-5 field trials in the United States and Canada, Part I: study design, sampling strategy, implementation, and analytic approaches. Am J Psychiatry (AJP), 2013 Jan 1; 170 (1): 43–58. (16 p.) Google: "DSM V Field Trials AJP Part 1 pdf" (p. 47)

Sim, Julius & Chris C. Wright (2005): Perspective. The Kappa Statistic in Reliability Studies: Use, Interpretation, and Sample Size Requirements. Physical Therapy 2005 (March), Vol. 85, no 3: 257–286. (12 p.) Google: “Sim Kappa Statistic Reliability 2005 pdf”

pp. 261 - 262.

Pertti Luukkonen, psychologist, Lic.Phil.

viewtopic.php?f=10&t=4557

"Reliability" has long been defined as the ratio of the true to the observed variance of the measures assessed. In the case of a binary outcome, the true measure for subject (i) is p(i), the probability that a randomly chosen observation is positive. Thus the intraclass kappa is defined as k=Variance(p(i))/PP', where P (equal to the expected value of p(i) over subjects) is the prevalence in the population of subjects sampled, and P'=1-P. PP' is the variance of a single binary observation in that population.

(- -)

I hope this helps. Helena Kraemer

-

Psykopatologia - Ylläpitäjä

- Viestit: 57805

- Liittynyt: 12.02.2010 13:19

- Paikkakunta: Helsinki

Re: DSM-5: J o h d a n t o

Voitko tiivistetysti PP:ia suomentaa mulle mitä tuossa mailissa puhutaan? Enkku on mulle vaikeaa, en ole kyennyt keskittymään enkun opettelemiseen.

- Pinja

Re: DSM-5: J o h d a n t o

En ymmärrä itsekään.

-

Psykopatologia - Ylläpitäjä

- Viestit: 57805

- Liittynyt: 12.02.2010 13:19

- Paikkakunta: Helsinki

Re: DSM-5: J o h d a n t o

Comorbidity of major depressive disorder (MDD), posttraumatic stress disorder (PTSD), alcohol use disorder (AUD) and generalized anxiety disorder (GAD).

Rates are average weighted percentages from HVA-M (aikuiset, N 264). (DSM-5 Field Trials 2, Regier et al. 2013 Fig. 1 (p. 66).

-

Psykopatologia - Ylläpitäjä

- Viestit: 57805

- Liittynyt: 12.02.2010 13:19

- Paikkakunta: Helsinki

Re: DSM-5: J o h d a n t o

(- -)

2.3.2. DSM-5: Reliabiliteetti-testausten tulosten arviointia

________________________________________________________________________________________________________________

Taulukko 8 A & B (s. 17 – 18) on tiivistetty Task Forcen ja muiden APAlaisten omien kirjoitusten ja taulukoiden pohjalta

(DSM-5 Field Trials 2 ym.).

Taulukko 9 A & B (s. 20 – 21) on oma tulkintani.

________________________________________________________________________________________________________________

-

DSM-5:n kenttäkokeissa (field trials) oli alun perin kohteeena (target) 30 diagnostista kriteeristöä. Kun sekä aikuisilla että nuorilla oli neljä samaa diagnoosia (PTSD, B-P, MDD ja mix A–D), tuli aikuisten osalle 21 ja nuorten osalle 12 diagnoosia, yhteensä 33 (21 / 12). Näistä 22:lle (33:sta) (aikuiset 15 / 8 nuoret) saatiin määritetyä asianmukaiset intra-class kappan (κ) arvot. Aikuisilla tarkemmin määrittämättömiksi jäi 6 ja nuorilla 4 diagnoosia, jotka on merkitty yhdellä (1) *tähdellä (taulukoissa 8 & 9) ja lisäksi F:llä (”failure” taulukossa 8). – ”Omassa” taulukossa 9 epäonnistuneiden diagnoosien ranki-numerot ovat aikuisilla 15 – 20 (kuusi) ja nuorilla 7 – 10 (neljä kappaletta).

Kirjoittajilla (DSM-5 Field Trials 2) hyvän (G, ”good”) tai sitä paremman alarajana on kappa 0,40 (taulukko 8), minkä saavutti 14 diagnoosia, aikuisissa 10 ja nuorissa 4, täten 14 (10/4). (Mielestäni 0,40+ on kernaammin vain ”riittävän hyvä”.) Tämän (0,40+) mukaan ”onnistumisia” oli aikuisissa noin puolet, 10/21 diagnoosia, ja nuorissa vain kolmannes, 4/12 diagnoosia, kokonaisuutena 14 / 33 diagnoosi-kriteeristöä eli vajaa puolet (vrt. alla).

Kirjoittajat ignoroivat kernaasti ko. ”hylkyjä” (yllä) ja keskittyvät analyyseissään niihin, joista reliabiliteetti voitiin määrittää (aikuiset / nuoret), so. very good (3/2), good (7/2), questionble (4/2), unaccebtable (1/2). Taulukossa 9 näiden ranki-numerot ovat aikuisissa 1 – 14 & 21 (viisitoista) ja nuorissa 1 – 6 & 11 – 12 (kahdeksan diagnoosi-kriteeristöä), yhteensä 23 (aikuiset 15/8 lapset & nuoret).

Näin tarkasteluna ”onnistumisia” (0,40+) oli aikuisissa kaksi kolmannesta, 10/15 diagnoosia, ja nuorissa puolet, 4/8 diagnoosia, yhteensä 14/23 eli vajaa kaksi kolmannesta (vrt. yllä). Tutkijat katsovat omahyväisesti olevansa ikään kuin ”voiton puolella”! (Vrt. myös **-kritiikki (”rusinat pullasta”), s. 20, |a, b| alaviite.)

_____________________________________________________________________________________________________________________

T a u l u k k o 9 A & B (s. 19)

[ T A U L U K K O ]

n Jos n on 2 – 6 (MDD), kappa-arvo on ”pooled”.

*An unsuccessful Field Trial (in obtaining accurate estimate of kappa) refers to one in which the size of the 95 % CI aroud the reliability coefficient was > 0,5, which indicates a lack of precision (SE > 0,1) in the estimation of the reliability coefficient (insufficient sample sizes). – Nämä olen sijoittanut automaattisesti “epäonnistuneisiin”.

**Since the individual intra-class kappas for the stratified samples and their 95 % CIs do not overlap, the pooled intra-class kappa needs to be interpreted with caution. – Näistä olen sijoittanut “hyviin+” kaksi, **B-P I:n (k 0,56) ja **BPD:n (k 0,54), joilla on (aikuisissa) rankit 8 ja 9. **mild NCD:llä (k 0,48) on “kyseenalaisissa” paras sija, 10.

|a, b| Kokonaisotos on muodostunut kolmesta (a **mild NCD; k 0,48) ja kahdesta (b mild TBI; k 0,36) erillisestä otoksesta, mutta tutkijat ovat pudottaneet DVA:n pois luultavasti tuloksen suuren varianssin vuoksi. Jos DVA olisi otettu mukaan pooliin, olisi koko poolin tulos saattanut olla suuren varianssin vuoksi tarkemmin määrittelemättömien luokassa. Menettely ei ole korrekti. Ei saisi ottaa vain (ikään kuin) rusinoita pullasta.

|c| APS (aikuiset, ranki 16) on DSM-5-manuaalissa (III, pp. 783 – 786) luokassa Conditions for further study.

|d| NSSI (pediatriset, 11; kelvoton (Baystate) ja tarkemmin määrittelemätön (Columbia) on DSM-5-manuaalissa (III, pp. 803 – 804) luokassa Conditions for further study.

|e| mix A – D ei ole DSM-5:ssä mutta on DSM-IV:n Appendix B:ssä, pp. 723 – 725 (myös DSM-IV-TR 2000: 780 – 781).

_____________________________________________________________________________________________________________________

_____________________________________________________________________________________________________________________

Taulukko 8 A & B. kappa-kertoimia (korkeusjärjestyksessä) tautiluokituksissa 1980 – 2013.

[ T A U L U K K O ]

Taulukosta on jätetty desimaalipilkut (tai pisteet) pois. Täten esimerkiksi 69 tarkoittaa +0,69 (eli .69).

(Selitykset *s. 18)

DSM-5: Field Trials 2, Regier et al. 2013 Table 2 (p. 63), Table 3 (p. 64), Table 4 & 5 (p. 65); DSM-IV: 1994 & ICD-10 1992,

1 Boring Old Man 2012 a; DSM-III: Appendix F (pp. 467 – 472), 1 Boring Old Man 2012 a.

_____________________________________________________________________________________________________________________

Taulukon 8 (s. 19) viidennen, DSM-III-sarakkeen tarkastelu (alla), antaa osviittaa siihen, minkä olen alustavasti jo todennut (*s. 4):

Eri aikaan tehdyt tutkimukset eivät koskaan ole suoraan keskenään vertailukelpoisia. (Vrt. kappa-kokoomat: taulukko 3, s. 4; taulukko 4, s. 5; taulukko 5, s. 9). Vaikka muuttujien nimet voivat olla (suunnilleen) samoja, niiden aktuaali sisältö voi olla enemmän tai vähemmän eri, eikä niiden laittaminen samaan taulukkoon ole korrektia. Reliabiliteetti on myös populaatio- ja otos-spesifinen: Otosten koot ja kokoomistapa voivat vaihdella (etukäteen valittu vrt. edustava tai enemmän tai vähemmän umpimähkäinen), ja erilaiset varianssit tuottavat erilaisia tuloksia siten, että homogeenisissa konteksteissa saatu reliabiliteetti-kerroin on matalampi kuin heterogeenisissa yhteyksissä saatu.

Innokkaiden kriitikoiden ja vertailijoiden tarkoituksena on ollut osoittaa DSM-5:n kenttä-kokeiden kehnous. Proseduuri on nyt kuitenkin ollut laajempi ja perusteellisempi kuin koskaan. Luulenkin, että nyt saadut tulokset ovat ”oikeampia” kuin aiemmat luultavasti osin keinotekoisen hyvät tulokset. Sillä eihän skaaloja ole alun perin tehtykään niin tarkan psykometrisesti kuin esimerkiksi psykologisia testejä on tehty!

30.12.2013 1:51

Omassa arvioinnissani – taulukko 8 A & B (s. 20 – 21) - päädyn siihen, että ”riittävän hyviä” (0,40+)

diagnoosi-kriteerien estimaatteja on aikuisissa kymmenen (rankit 1 – 10), tiukasti ottaen seitsemän

(1 – 7), ja lapsissa & nuorissa neljä (rankit 1 – 4), yhteensä 11 – 14 (aikuiset 7–10 / 4 nuoret).

30.12.2013 16:08

Olen ottanut sen kannan, että (A)aikuisissa ”hyvien” (ranki 7)alcohol use disorder (AUD; k 0,40) on skaalana onnistunut paremmin kuin (8)**bi-polar I disorder (B-P I; k 0,56) ja (9)**borderline personality disorder (BPD 0,54), koska näillä – vaikka kappa on korkeampi – kokonais-varianssi on suuri ja jakauma kaksi-huippuinen. – (10)**mild neurocognitive disorder (mild NCD; k 48) on sitten jo ”kyseenalaisten” parhaana (tutkijoilla kuitenkin good).

Tässä on hyvä tuoda esiin, että periaatteessa tutkijoiden ”erimielisyys” (disagreement) voi toteutua kahdella tavalla: (1) Molemmat arvioijat katsovat, että tutkittava on häiriintynyt (agreement) mutta että diagnoosi on eri (disagreement). Esimerkiksi toinen arvioi kyseessä olevan skitsofrenian ja toinen paranoidisen psykoosin. (2) Toinen arvioi, että tutkittavalla on diagnosoitavissa oleva häiriö ja toinen, että tutkittava on (suhteellisen) oireeton tai normaali; täten siis ei diagnoosia (disagreement).

2-vaihtoehto ei toteudu tässä tutkimuksessa: kaikilla tutkituilla oli luultavasti ainakin joku häiriö, ja monilla oli oheis-häiriintyneisyyttä (monihäiriöisiä). Normaalit sen sijaan puuttuivat. Reliabiliteetin tutkimisen kannalta asetelma ei ole ”todellinen”. Jotta otos olisi prevalenssien suhteen edustava, tulisi normaaleita olla runsaasti yli puolet, kenties n. 65 – 85 %, riippuen siitä, kuinka laajasti häiriö määritellään. Normaalien mukana olo alentaisi arvioisija-reliabiliteetteja. Tällainen tutkimus kävisi kuitenkin mahdottoman laajaksi.

31.12.2013 20:16

Jos palataan alkuun – 33 (21/12) – ”riittävän hyviä” diagnostisia kriteeri-skaaloja saatiin aikuisissa vajaa puolet, 9/21 ja lapsissa & nuorissa kolmannes, 4/12, yhteensä 13/33 eli runsas kolmannes.

_

2.3.2. DSM-5: Reliabiliteetti-testausten tulosten arviointia

________________________________________________________________________________________________________________

Taulukko 8 A & B (s. 17 – 18) on tiivistetty Task Forcen ja muiden APAlaisten omien kirjoitusten ja taulukoiden pohjalta

(DSM-5 Field Trials 2 ym.).

Taulukko 9 A & B (s. 20 – 21) on oma tulkintani.

________________________________________________________________________________________________________________

-

DSM-5:n kenttäkokeissa (field trials) oli alun perin kohteeena (target) 30 diagnostista kriteeristöä. Kun sekä aikuisilla että nuorilla oli neljä samaa diagnoosia (PTSD, B-P, MDD ja mix A–D), tuli aikuisten osalle 21 ja nuorten osalle 12 diagnoosia, yhteensä 33 (21 / 12). Näistä 22:lle (33:sta) (aikuiset 15 / 8 nuoret) saatiin määritetyä asianmukaiset intra-class kappan (κ) arvot. Aikuisilla tarkemmin määrittämättömiksi jäi 6 ja nuorilla 4 diagnoosia, jotka on merkitty yhdellä (1) *tähdellä (taulukoissa 8 & 9) ja lisäksi F:llä (”failure” taulukossa 8). – ”Omassa” taulukossa 9 epäonnistuneiden diagnoosien ranki-numerot ovat aikuisilla 15 – 20 (kuusi) ja nuorilla 7 – 10 (neljä kappaletta).

Kirjoittajilla (DSM-5 Field Trials 2) hyvän (G, ”good”) tai sitä paremman alarajana on kappa 0,40 (taulukko 8), minkä saavutti 14 diagnoosia, aikuisissa 10 ja nuorissa 4, täten 14 (10/4). (Mielestäni 0,40+ on kernaammin vain ”riittävän hyvä”.) Tämän (0,40+) mukaan ”onnistumisia” oli aikuisissa noin puolet, 10/21 diagnoosia, ja nuorissa vain kolmannes, 4/12 diagnoosia, kokonaisuutena 14 / 33 diagnoosi-kriteeristöä eli vajaa puolet (vrt. alla).

Kirjoittajat ignoroivat kernaasti ko. ”hylkyjä” (yllä) ja keskittyvät analyyseissään niihin, joista reliabiliteetti voitiin määrittää (aikuiset / nuoret), so. very good (3/2), good (7/2), questionble (4/2), unaccebtable (1/2). Taulukossa 9 näiden ranki-numerot ovat aikuisissa 1 – 14 & 21 (viisitoista) ja nuorissa 1 – 6 & 11 – 12 (kahdeksan diagnoosi-kriteeristöä), yhteensä 23 (aikuiset 15/8 lapset & nuoret).

Näin tarkasteluna ”onnistumisia” (0,40+) oli aikuisissa kaksi kolmannesta, 10/15 diagnoosia, ja nuorissa puolet, 4/8 diagnoosia, yhteensä 14/23 eli vajaa kaksi kolmannesta (vrt. yllä). Tutkijat katsovat omahyväisesti olevansa ikään kuin ”voiton puolella”! (Vrt. myös **-kritiikki (”rusinat pullasta”), s. 20, |a, b| alaviite.)

_____________________________________________________________________________________________________________________

T a u l u k k o 9 A & B (s. 19)

[ T A U L U K K O ]

n Jos n on 2 – 6 (MDD), kappa-arvo on ”pooled”.

*An unsuccessful Field Trial (in obtaining accurate estimate of kappa) refers to one in which the size of the 95 % CI aroud the reliability coefficient was > 0,5, which indicates a lack of precision (SE > 0,1) in the estimation of the reliability coefficient (insufficient sample sizes). – Nämä olen sijoittanut automaattisesti “epäonnistuneisiin”.

**Since the individual intra-class kappas for the stratified samples and their 95 % CIs do not overlap, the pooled intra-class kappa needs to be interpreted with caution. – Näistä olen sijoittanut “hyviin+” kaksi, **B-P I:n (k 0,56) ja **BPD:n (k 0,54), joilla on (aikuisissa) rankit 8 ja 9. **mild NCD:llä (k 0,48) on “kyseenalaisissa” paras sija, 10.

|a, b| Kokonaisotos on muodostunut kolmesta (a **mild NCD; k 0,48) ja kahdesta (b mild TBI; k 0,36) erillisestä otoksesta, mutta tutkijat ovat pudottaneet DVA:n pois luultavasti tuloksen suuren varianssin vuoksi. Jos DVA olisi otettu mukaan pooliin, olisi koko poolin tulos saattanut olla suuren varianssin vuoksi tarkemmin määrittelemättömien luokassa. Menettely ei ole korrekti. Ei saisi ottaa vain (ikään kuin) rusinoita pullasta.

|c| APS (aikuiset, ranki 16) on DSM-5-manuaalissa (III, pp. 783 – 786) luokassa Conditions for further study.

|d| NSSI (pediatriset, 11; kelvoton (Baystate) ja tarkemmin määrittelemätön (Columbia) on DSM-5-manuaalissa (III, pp. 803 – 804) luokassa Conditions for further study.

|e| mix A – D ei ole DSM-5:ssä mutta on DSM-IV:n Appendix B:ssä, pp. 723 – 725 (myös DSM-IV-TR 2000: 780 – 781).

_____________________________________________________________________________________________________________________

_____________________________________________________________________________________________________________________

Taulukko 8 A & B. kappa-kertoimia (korkeusjärjestyksessä) tautiluokituksissa 1980 – 2013.

[ T A U L U K K O ]

Taulukosta on jätetty desimaalipilkut (tai pisteet) pois. Täten esimerkiksi 69 tarkoittaa +0,69 (eli .69).

(Selitykset *s. 18)

DSM-5: Field Trials 2, Regier et al. 2013 Table 2 (p. 63), Table 3 (p. 64), Table 4 & 5 (p. 65); DSM-IV: 1994 & ICD-10 1992,

1 Boring Old Man 2012 a; DSM-III: Appendix F (pp. 467 – 472), 1 Boring Old Man 2012 a.

_____________________________________________________________________________________________________________________

Taulukon 8 (s. 19) viidennen, DSM-III-sarakkeen tarkastelu (alla), antaa osviittaa siihen, minkä olen alustavasti jo todennut (*s. 4):

Eri aikaan tehdyt tutkimukset eivät koskaan ole suoraan keskenään vertailukelpoisia. (Vrt. kappa-kokoomat: taulukko 3, s. 4; taulukko 4, s. 5; taulukko 5, s. 9). Vaikka muuttujien nimet voivat olla (suunnilleen) samoja, niiden aktuaali sisältö voi olla enemmän tai vähemmän eri, eikä niiden laittaminen samaan taulukkoon ole korrektia. Reliabiliteetti on myös populaatio- ja otos-spesifinen: Otosten koot ja kokoomistapa voivat vaihdella (etukäteen valittu vrt. edustava tai enemmän tai vähemmän umpimähkäinen), ja erilaiset varianssit tuottavat erilaisia tuloksia siten, että homogeenisissa konteksteissa saatu reliabiliteetti-kerroin on matalampi kuin heterogeenisissa yhteyksissä saatu.

Innokkaiden kriitikoiden ja vertailijoiden tarkoituksena on ollut osoittaa DSM-5:n kenttä-kokeiden kehnous. Proseduuri on nyt kuitenkin ollut laajempi ja perusteellisempi kuin koskaan. Luulenkin, että nyt saadut tulokset ovat ”oikeampia” kuin aiemmat luultavasti osin keinotekoisen hyvät tulokset. Sillä eihän skaaloja ole alun perin tehtykään niin tarkan psykometrisesti kuin esimerkiksi psykologisia testejä on tehty!

30.12.2013 1:51

Omassa arvioinnissani – taulukko 8 A & B (s. 20 – 21) - päädyn siihen, että ”riittävän hyviä” (0,40+)

diagnoosi-kriteerien estimaatteja on aikuisissa kymmenen (rankit 1 – 10), tiukasti ottaen seitsemän

(1 – 7), ja lapsissa & nuorissa neljä (rankit 1 – 4), yhteensä 11 – 14 (aikuiset 7–10 / 4 nuoret).

30.12.2013 16:08

Olen ottanut sen kannan, että (A)aikuisissa ”hyvien” (ranki 7)alcohol use disorder (AUD; k 0,40) on skaalana onnistunut paremmin kuin (8)**bi-polar I disorder (B-P I; k 0,56) ja (9)**borderline personality disorder (BPD 0,54), koska näillä – vaikka kappa on korkeampi – kokonais-varianssi on suuri ja jakauma kaksi-huippuinen. – (10)**mild neurocognitive disorder (mild NCD; k 48) on sitten jo ”kyseenalaisten” parhaana (tutkijoilla kuitenkin good).

Tässä on hyvä tuoda esiin, että periaatteessa tutkijoiden ”erimielisyys” (disagreement) voi toteutua kahdella tavalla: (1) Molemmat arvioijat katsovat, että tutkittava on häiriintynyt (agreement) mutta että diagnoosi on eri (disagreement). Esimerkiksi toinen arvioi kyseessä olevan skitsofrenian ja toinen paranoidisen psykoosin. (2) Toinen arvioi, että tutkittavalla on diagnosoitavissa oleva häiriö ja toinen, että tutkittava on (suhteellisen) oireeton tai normaali; täten siis ei diagnoosia (disagreement).

2-vaihtoehto ei toteudu tässä tutkimuksessa: kaikilla tutkituilla oli luultavasti ainakin joku häiriö, ja monilla oli oheis-häiriintyneisyyttä (monihäiriöisiä). Normaalit sen sijaan puuttuivat. Reliabiliteetin tutkimisen kannalta asetelma ei ole ”todellinen”. Jotta otos olisi prevalenssien suhteen edustava, tulisi normaaleita olla runsaasti yli puolet, kenties n. 65 – 85 %, riippuen siitä, kuinka laajasti häiriö määritellään. Normaalien mukana olo alentaisi arvioisija-reliabiliteetteja. Tällainen tutkimus kävisi kuitenkin mahdottoman laajaksi.

31.12.2013 20:16

Jos palataan alkuun – 33 (21/12) – ”riittävän hyviä” diagnostisia kriteeri-skaaloja saatiin aikuisissa vajaa puolet, 9/21 ja lapsissa & nuorissa kolmannes, 4/12, yhteensä 13/33 eli runsas kolmannes.

_

-

Psykopatologia - Ylläpitäjä

- Viestit: 57805

- Liittynyt: 12.02.2010 13:19

- Paikkakunta: Helsinki

Re: DSM-5: J o h d a n t o

K i r j a l l i s u u s •(myös) verkossa.

_____________________________________________________________________________________________________________________

•Boring Old Man (nimimerkki), •*1 Boring Old Man (kirjallisuuden lopussa).

•DSM-I (1952). Diagnostic and Statistical Manual: Mental Disorders. Chairman George Raines. Washington, D. C.: American Psychiatric Association (APA). – xii + 132 (144) p. Google “DSM-I pdf” (145 p.)

•DSM-II (1968). Diagnostic and Statistical Manual of Mental Disorders (Second Edition). Chairman Ernest Gruenberg. APA. – xv + 119 (134) p. Google “DSM-II pdf”

DSM-III (1980). Chairperson Robert Spitzer. APA. – ix + 494 (503) p.

DSM-III-R (1987). DSM-III-Revised. Chair Spitzer. APA. – xxix + 567 (596) p.

•DSM-IV (1994). Chairperson Allen Frances. – xxvii + 886 (913) p. Google: “DSM-IV pdf” (915 p.)

DSM-IV-TR (2000). DSM-IV-Text Revision. APA. Co-Chairperson and Editor Michael First. – xxxvii + 943 (980) p.

DSM-5 (2013).Task Force Chair David Kupfer. Arlington, VA: APA.– xliv + 947 (991) p.

•DSM-5 Field Trials 1. Clarke, Diana E. et al. (2013) (William E. Narrow, Darrel E. Regier, S. Janet Kuramoto, David J. Kupfer, Emily A. Kuhl, Lisa Greiner & Helena C. Kraemer [8]): Article. DSM-5 field trials in the United States and Canada, Part I: study design, sampling strategy, implementation, and analytic approaches. Am J Psychiatry (AJP), 2013 Jan 1; 170 (1): 43–58. (16 p.) Google: "DSM V Field Trials AJP Part 1 pdf" (Vrt. *Friedman et al., Editorial; alla.)

•DSM-5 Field Trials 2. Regier, Darrel A. et al. (2013) (William E. Narrow, Diana E. Clarke, Helena C. Kraemer, S. Janet Kuramoto, Emily A. Kuhl & David J. Kupfer [7]. Article. DSM-5 Field Trials in the United States and Canada, Part II: Test-Retest Reliability of Selected Categorical Diagnoses. Am J Psychiatry (AJP) 2013, Jan 1; 170: 59–70. (12 p.) Google: "DSM V Field Trials AJP Part 2 pdf" (Vrt. *Friedman et al., Editorial; alla.)

•DSM-5 Field Trials 3. Narrow, William. E. et al. (2013) (Diana E. Clarke, S. Janet Kura-moto, Helena C. Kraemer, David J. Kupfer, Lisa Greiner & Darrel A. Regier [7]): Article. DSM-5 Field Trials in the United States and Canada, Part III: Development and Reliability Testing of a Cross-Cutting Symptom Assessment for DSM-5. Am J Psychiatry (AJP) 2013; Jan 1, 170: 71–82. (12 p.) Google: "DSM V Field Trials AJP Part 3 pdf" (Vrt. *Friedman et al., Editorial; alla.)

•DSM-5 Field Trials 4, Editorial (keskustelu kohdista 1–3, yllä.) Freedman, Robert et al. (2013) (David A. Lewis, Robert Michels, Daniel S. Pine, Susan K. Schultz, Carol A. Tamminga, Glen O. Gabbard, Susan Shur-Fen Gau, Daniel C. Javitt, Maria A. Oquendo, Patrick E. Shrout, Eduard Vieta & Joel Yager [13]): The Initial Field Trials of DSM-5: New Blooms and Old Thorns. Am J Psychiatry (AJP) 2013 Jan 1; 170: 1–5.

(5 p.) Google: "Initial Field Trials Editorials pdf"

•Feighner, John P. et al. 1972 (Eli Robins, Samuel B. Guze, Robert A. Woodruff Jr, George Winokur & Rodrigo Munoz): Diagnostic Criteria for Use in Psychiatric Research. Arch Gen Psychiat / Vol 26, Jan 1972: 57–63. (7 p.) Google: “Feighner Diagnostic Criteria 1972 pdf”

Freeman, Daniel & Jason Freeman (2012): The Stressed Sex. Uncovering the Truth About Men, Women, and Mental Health. Oxford (UK): Oxford University Press.– x + 267 p.

•Kirk, Stuart A. & Herb Kutchins (1994): The Myth of Reliability of DSM. J Mind Behav. 1994, 15 (1 & 2): 71–86. (16 p.) (Reprinted: Academy for the Study of the Psychoanalytic Arts) Google “Myth of Reliability of DSM”

•Krueger, Robert F. & Kristian E. Markon (2006): Reinterpreting Comorbidity: A Model-Based Approach to Understanding and Classifying Psychopathology. Annu Rev Clin Psychol. 2006; 2: 111–133. (23 p.) Google: “Reinterpreting Comorbidity”. – Robert Frank (“Bob”) Krueger (s. 1970) on ollut DSM-5:n Personality & Personality Disorders Work Groupin Text Coordinator.

Luukkonen, Pertti (2008): Kliinisen psykologian ensyklopedia internet-linkitetty. Helsinki: Psykopatologia. – vi + 266 + 15 + 16 (304) s.

•Ofrat, Shani & Robert Krueger (2012): Perspective. How research on the meta-structure of psychopathology aids in understanding biological correlates of mood and anxiety disorders. Biology of Mood & Anxiety Disorders, 2012, 2: 13. Google: “Shani Ofrat Robert Krueger 2012 pdf”

Sadock, Benjamin J. & Virginia A. Sadock (2010): Kaplan & Sadock’s Pocket Handbook of Clinical Psychiatry. Fifth Edition. Contributing Editors Gary S. Belkin (senior) et al. Philadelphia (etc.): Wolters Kluwer| Lippincott Williams & Wilkins, Health. – ix + 566 p.

•Sim, Julius & Chris C. Wright (2005): Perspective. The Kappa Statistic in Reliability Studies: Use, Interpretation, and Sample Size Requirements. Physical Therapy 2005 (March), Vol. 85, no 3: 257–286. (12 p.) Google: “Sim Kappa Statistic Reliability 2005 pdf”

•Spitzer, Robert L. & Joseph L. Fleiss (1974): A Re-analysis of the Reliability of Psychiatric Diagnosis. Brit. J. Psychiat. 1974, Vol. 125 (October), 341–347 (7 p.). Google: “Spitzer Fleiss Re-analysis Reliability Psychiatric 1974 pdf”

•Spitzer, Robert L. et al. (1978) (Jean Endicott & Eli Robins): Research Diagnostic Crite-ria: Rationale and Reliability. Arch Gen Psychiatry, 1978; 35(6): 773–782. (11 p.) Google: ”Research Diagnostic Criteria 1978 pdf”

•1 Boring Old Man (John Michael Nardo) (2012 a) take a notice… Google: “Boring Old notice”

•1 Boring Old Man (2012 b): “but this is ridiculous”… Google: Boring Old ridiculous”

•1 Boring Old Man (2012 c): speaking of forests… Google: “Boring speaking of forests”

_____________________________________________________________________________________________________________________

•Boring Old Man (nimimerkki), •*1 Boring Old Man (kirjallisuuden lopussa).

•DSM-I (1952). Diagnostic and Statistical Manual: Mental Disorders. Chairman George Raines. Washington, D. C.: American Psychiatric Association (APA). – xii + 132 (144) p. Google “DSM-I pdf” (145 p.)

•DSM-II (1968). Diagnostic and Statistical Manual of Mental Disorders (Second Edition). Chairman Ernest Gruenberg. APA. – xv + 119 (134) p. Google “DSM-II pdf”

DSM-III (1980). Chairperson Robert Spitzer. APA. – ix + 494 (503) p.

DSM-III-R (1987). DSM-III-Revised. Chair Spitzer. APA. – xxix + 567 (596) p.

•DSM-IV (1994). Chairperson Allen Frances. – xxvii + 886 (913) p. Google: “DSM-IV pdf” (915 p.)

DSM-IV-TR (2000). DSM-IV-Text Revision. APA. Co-Chairperson and Editor Michael First. – xxxvii + 943 (980) p.

DSM-5 (2013).Task Force Chair David Kupfer. Arlington, VA: APA.– xliv + 947 (991) p.

•DSM-5 Field Trials 1. Clarke, Diana E. et al. (2013) (William E. Narrow, Darrel E. Regier, S. Janet Kuramoto, David J. Kupfer, Emily A. Kuhl, Lisa Greiner & Helena C. Kraemer [8]): Article. DSM-5 field trials in the United States and Canada, Part I: study design, sampling strategy, implementation, and analytic approaches. Am J Psychiatry (AJP), 2013 Jan 1; 170 (1): 43–58. (16 p.) Google: "DSM V Field Trials AJP Part 1 pdf" (Vrt. *Friedman et al., Editorial; alla.)

•DSM-5 Field Trials 2. Regier, Darrel A. et al. (2013) (William E. Narrow, Diana E. Clarke, Helena C. Kraemer, S. Janet Kuramoto, Emily A. Kuhl & David J. Kupfer [7]. Article. DSM-5 Field Trials in the United States and Canada, Part II: Test-Retest Reliability of Selected Categorical Diagnoses. Am J Psychiatry (AJP) 2013, Jan 1; 170: 59–70. (12 p.) Google: "DSM V Field Trials AJP Part 2 pdf" (Vrt. *Friedman et al., Editorial; alla.)

•DSM-5 Field Trials 3. Narrow, William. E. et al. (2013) (Diana E. Clarke, S. Janet Kura-moto, Helena C. Kraemer, David J. Kupfer, Lisa Greiner & Darrel A. Regier [7]): Article. DSM-5 Field Trials in the United States and Canada, Part III: Development and Reliability Testing of a Cross-Cutting Symptom Assessment for DSM-5. Am J Psychiatry (AJP) 2013; Jan 1, 170: 71–82. (12 p.) Google: "DSM V Field Trials AJP Part 3 pdf" (Vrt. *Friedman et al., Editorial; alla.)

•DSM-5 Field Trials 4, Editorial (keskustelu kohdista 1–3, yllä.) Freedman, Robert et al. (2013) (David A. Lewis, Robert Michels, Daniel S. Pine, Susan K. Schultz, Carol A. Tamminga, Glen O. Gabbard, Susan Shur-Fen Gau, Daniel C. Javitt, Maria A. Oquendo, Patrick E. Shrout, Eduard Vieta & Joel Yager [13]): The Initial Field Trials of DSM-5: New Blooms and Old Thorns. Am J Psychiatry (AJP) 2013 Jan 1; 170: 1–5.

(5 p.) Google: "Initial Field Trials Editorials pdf"

•Feighner, John P. et al. 1972 (Eli Robins, Samuel B. Guze, Robert A. Woodruff Jr, George Winokur & Rodrigo Munoz): Diagnostic Criteria for Use in Psychiatric Research. Arch Gen Psychiat / Vol 26, Jan 1972: 57–63. (7 p.) Google: “Feighner Diagnostic Criteria 1972 pdf”

Freeman, Daniel & Jason Freeman (2012): The Stressed Sex. Uncovering the Truth About Men, Women, and Mental Health. Oxford (UK): Oxford University Press.– x + 267 p.

•Kirk, Stuart A. & Herb Kutchins (1994): The Myth of Reliability of DSM. J Mind Behav. 1994, 15 (1 & 2): 71–86. (16 p.) (Reprinted: Academy for the Study of the Psychoanalytic Arts) Google “Myth of Reliability of DSM”

•Krueger, Robert F. & Kristian E. Markon (2006): Reinterpreting Comorbidity: A Model-Based Approach to Understanding and Classifying Psychopathology. Annu Rev Clin Psychol. 2006; 2: 111–133. (23 p.) Google: “Reinterpreting Comorbidity”. – Robert Frank (“Bob”) Krueger (s. 1970) on ollut DSM-5:n Personality & Personality Disorders Work Groupin Text Coordinator.

Luukkonen, Pertti (2008): Kliinisen psykologian ensyklopedia internet-linkitetty. Helsinki: Psykopatologia. – vi + 266 + 15 + 16 (304) s.

•Ofrat, Shani & Robert Krueger (2012): Perspective. How research on the meta-structure of psychopathology aids in understanding biological correlates of mood and anxiety disorders. Biology of Mood & Anxiety Disorders, 2012, 2: 13. Google: “Shani Ofrat Robert Krueger 2012 pdf”

Sadock, Benjamin J. & Virginia A. Sadock (2010): Kaplan & Sadock’s Pocket Handbook of Clinical Psychiatry. Fifth Edition. Contributing Editors Gary S. Belkin (senior) et al. Philadelphia (etc.): Wolters Kluwer| Lippincott Williams & Wilkins, Health. – ix + 566 p.

•Sim, Julius & Chris C. Wright (2005): Perspective. The Kappa Statistic in Reliability Studies: Use, Interpretation, and Sample Size Requirements. Physical Therapy 2005 (March), Vol. 85, no 3: 257–286. (12 p.) Google: “Sim Kappa Statistic Reliability 2005 pdf”

•Spitzer, Robert L. & Joseph L. Fleiss (1974): A Re-analysis of the Reliability of Psychiatric Diagnosis. Brit. J. Psychiat. 1974, Vol. 125 (October), 341–347 (7 p.). Google: “Spitzer Fleiss Re-analysis Reliability Psychiatric 1974 pdf”

•Spitzer, Robert L. et al. (1978) (Jean Endicott & Eli Robins): Research Diagnostic Crite-ria: Rationale and Reliability. Arch Gen Psychiatry, 1978; 35(6): 773–782. (11 p.) Google: ”Research Diagnostic Criteria 1978 pdf”

•1 Boring Old Man (John Michael Nardo) (2012 a) take a notice… Google: “Boring Old notice”

•1 Boring Old Man (2012 b): “but this is ridiculous”… Google: Boring Old ridiculous”

•1 Boring Old Man (2012 c): speaking of forests… Google: “Boring speaking of forests”

-

Psykopatologia - Ylläpitäjä

- Viestit: 57805

- Liittynyt: 12.02.2010 13:19

- Paikkakunta: Helsinki

Re: DSM-5: J o h d a n t o

Decker, Hannah S. (2013): The Making of DSM-III: A Diagnostic Manual's Conquest of American Psychiatry.

Oxford – New York: Universities Press. xxii + 443 p. (Lisätty 7.1.2014)

Description http://global.oup.com/academic/product/ ... escription

In 1973, the American Psychiatric Association decided to publish a revised edition of their Diagnostic and Statistical Manual (DSM). There was great hope that a new manual would display psychiatry as a scientific field and aid in combating the attacks of an aggressive anti-psychiatry movement that had persisted for more than a decade.

The Making of DSM-III® is a book about the manual that resulted in 1980-DSM-III-a far-reaching revisionist work that created a revolution in American psychiatry. Its development precipitated a historic clash between the DSM-III Task Force--a group of descriptive, empirically oriented psychiatrists and psychologists--and the psychoanalysts the Task Force was determined to dethrone from their dominance in American psychiatry. DSM-III also inaugurated an era in which it and the diagnostic manuals that followed played enormous roles in the daily lives of persons and organizations all over the world, for the DSMs have been translated into many languages.

The radical revision process was led by the psychiatrist Robert L. Spitzer, a many-talented man of great determination, energy, and tactical skills, arguably the most influential psychiatrist of the second half of the 20th Century. Spitzer created as major a change in descriptive psychiatry and classification as had the renowned German psychiatrist Emil Kraepelin, almost a century earlier. Kraepelin had been the epochal delineator of dementia praecox from manic-depressive illness, the forerunners of modern schizophrenia and bipolar disorder.

In her book, Hannah Decker portrays the many internal and external battles that roiled the creation of DSM-III and analyzes both its positive achievements and significant drawbacks. She also astutely explores the deleterious effects of the violent swings in scientific orientation that have dominated psychiatry over the past 200 years and are still alive today.

Decker has written a revealing and exciting book that is based on archival sources never before used as well as extensive interviews with the psychiatrists and psychologists who have brought into being the psychiatry we know today.

_____________________________________________________________________________________________________________________

Amazon

Your Orders | Your Account | Amazon.com

Shipping Confirmation

Order #106-5402722-0856227

Hello Pertti Luukkonen,

Thank you for shopping with us. We thought you'd like to know that we shipped your item, and that this completes your order. Your order is on its way, and can no longer be changed. If you need to return an item from this shipment or manage other orders, please visit Your Orders on Amazon.com.

Your guaranteed delivery date is:

Tuesday, January 7, 2014

Track your package Your order was sent to:

Pertti Luukkonen

Päivärinnankatu 4 A 4

Helsinki, 00250 HELSINKI 00250

Finland

Depending on the ship speed you chose, it may take 24 hours for tracking information to be available in your account.

Get a $10 gift card upon approval for the Amazon.com Store Card

Shipment Details

The Making of DSM-III®: A Diagnostic Manual's Conquest of American Psychiatry

Sold by Amazon Export Sales, Inc.

Facebook Twitter Pinterest

$49.16

Item Subtotal: $49.16

Shipping & Handling: $30.48

Promotion Applied: -$0.00

Total Before Tax: $79.64

Import Fees Deposit: $6.37

Shipment Total: $86.01

Paid by Mastercard: $86.01

Returns are easy. Visit our Online Return Center.

If you need further assistance with your order, please visit Customer Service.

We hope to see you again soon!

Amazon.com

Books

Prime

-

Psykopatologia - Ylläpitäjä

- Viestit: 57805

- Liittynyt: 12.02.2010 13:19

- Paikkakunta: Helsinki

Paluu Psykologiaa ja psykopatologiaa

Paikallaolijat

Käyttäjiä lukemassa tätä aluetta: Ei rekisteröityneitä käyttäjiä ja 10 vierailijaa